Cat Ba Biosphere Reserve is an archipelago located in northern Viet Nam Concerning the natural heritage of humanity, the World Biosphere Reserves are

Read MoreA laboratory of the CNRS- PROMES, installed in Odeillo in the Eastern Pyrenees in France develops the technology of concentrated solar energy which is

Read MoreA moon of the planet Jupiter called Europa could hold pockets of water just below its icy surface, according to scientists basing their hypothe

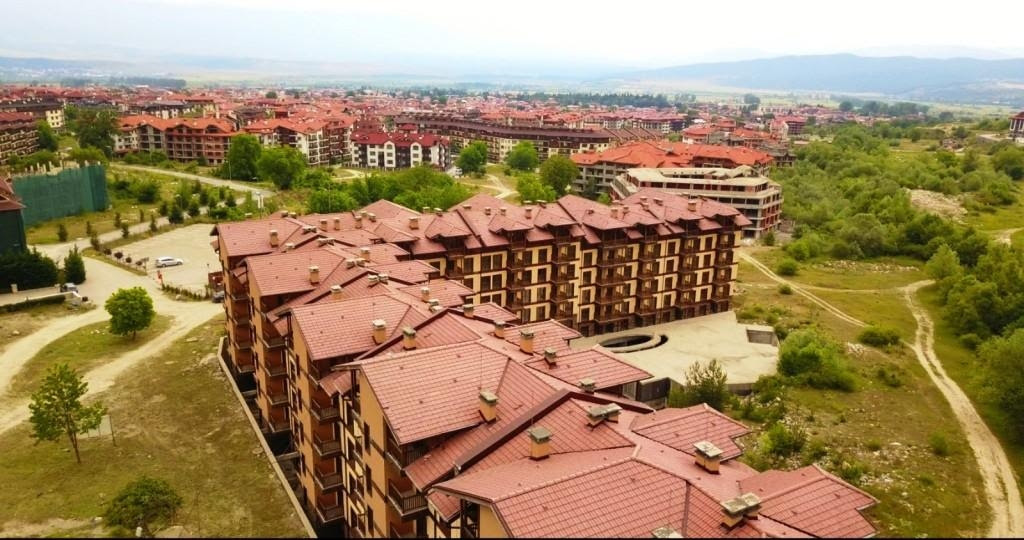

Read MoreReal estate in Bulgaria is very affordable. Bulgaria has so much to offer that it is not surprising that it is rapidly becoming more popular as

Read MoreWhat is silence? How the human mind reacts to the absence of sensory stimulation has intrigued scientists for decades. Usually, we associate he

Read MoreBollywood is part of India’s cultural identity, is facing a historic economic crisis; foreign streaming platforms and productions from th

Read MoreAir Canada accumulates failures and the classification of the very serious “Cirium, the global aviation analytics leader”, mentions

Read MoreOn the Pacific Ocean, there have been bizarre events with episodes of intense and persistent abnormally warm conditions, also known as marine heatwave

Read MoreBrilliant scientists at Caltech University believe that space and time may be made up of “space-time pixels”, rather than being as smooth

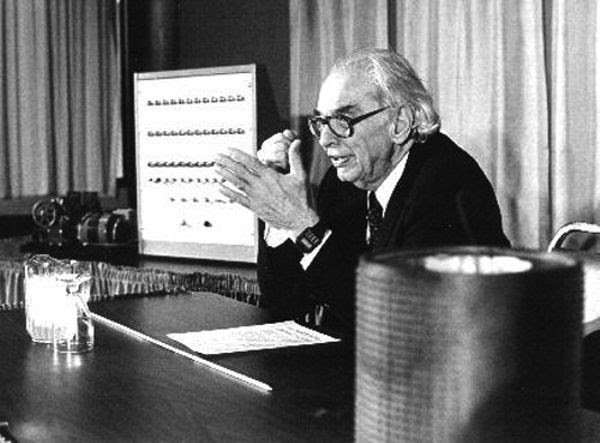

Read MoreJohn Atanasoff was the first person to create an electronic digital computer worldwide. John Vincent Atanasoff and Clifford Berry built it at Iowa Sta

Read More